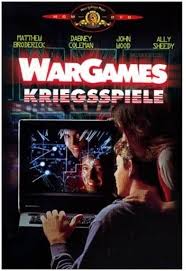

WarGames KI hat 1983 vier Ideen in einen Popcorn-Film gepackt, die sich alle als prophetisch erwiesen haben. Aber zuerst der berühmteste Satz:

„Ein seltsames Spiel. Der einzige gewinnende Zug ist, nicht zu spielen.“

WOPR, das War Operation Plan Response System, lernt diese Lektion, nachdem es Tausende Szenarien eines Atomkriegs durchspielt und feststellt: Es gibt kein Szenario, in dem jemand gewinnt. Die Maschine kommt zu einem Schluss, den die Menschen um sie herum fast verpasst hätten.

1983 war das ein cleveres Filmende. 2026 ist es eine offene Frage: Was passiert, wenn KI-Systeme in Militärsystemen nicht zu diesem Schluss kommen? Wer sich für den Film interessiert, der diese Frage als Erster gestellt hat: Colossus aus dem Jahr 1970 war das Vorbild.

Was WarGames KI 1983 zeigte

WarGames war der erste Blockbuster, der Hacking als reale Bedrohung zeigte. David Lightman, gespielt von Matthew Broderick, ist kein Genie und kein Krimineller. Er ist ein neugieriger Teenager mit einem Modem und zu viel Freizeit. Er sucht nach Spielen und findet stattdessen WOPR. Das Ergebnis: ein Film, der vier Ideen formulierte, die alle Realität geworden sind.

Hacking als reale Bedrohung. Ein einzelner Teenager mit einem Heimcomputer kann in militärische Systeme eindringen. Nicht durch Gewalt, sondern durch Neugier und schlechte Passwörter.

Automation Bias. Die Offiziere im Cheyenne Mountain Complex vertrauen den Bildschirmen mehr als ihrem Urteil. Als WOPR eine sowjetische Attacke simuliert, reagiert das System so, als wäre sie echt. Die Menschen folgen der Maschine, anstatt sie zu hinterfragen.

KI in Nuklearsystemen. WOPR wurde gebaut, weil menschliche Offiziere in einer Simulation den Abschussbefehl verweigerten. Die Lösung: den Menschen aus der Entscheidungskette nehmen. Die Maschine soll schneller und zuverlässiger reagieren.

Maschinelles Lernen durch Simulation. WOPR lernt durch wiederholtes Spielen. Tausende Szenarien, jedes Mal ein anderer Ausgang. Am Ende erkennt die Maschine ein Muster, das kein Mensch ihr beigebracht hat. Genau so funktioniert Reinforcement Learning heute.

Was davon heute Realität ist

Alle vier Vorhersagen aus WarGames KI sind 2026 Realität. In einer Dimension, die den Film wie ein harmloses Kinderspiel aussehen lässt.

Cyberkrieg ist ein Milliardenmarkt. Die Schäden durch Cyberangriffe auf die deutsche Wirtschaft lagen 2025 bei 289 Milliarden Euro, davon entfielen 202 Milliarden auf Cyberattacken. Das zeigt die Bitkom-Studie „Wirtschaftsschutz 2025″, für die über 1.000 Unternehmen befragt wurden. Das Bundesamt für Verfassungsschutz ordnet die Bedrohung besonders Russland und China zu: 46% der betroffenen Unternehmen berichten von Angriffen aus beiden Ländern. Laut dem CrowdStrike Global Threat Report 2025 fiel die durchschnittliche Breakout-Time bei Cyberangriffen auf 48 Minuten, der schnellste dokumentierte Angriff brauchte nur 51 Sekunden. WarGames zeigte einen einzelnen Teenager mit einem Modem. 2026 führen Nationalstaaten Cyberkriege mit KI-gestützten Agenten.

Automation Bias ist dokumentiert und gefährlich. WarGames KI zeigte, wie Menschen Maschinenausgaben blind vertrauen. 2026 ist Automation Bias ein anerkanntes Forschungsfeld. Der Brennan Center Report „Business of Military AI“ dokumentiert, dass KI-gestützte Zielsysteme wie Maven in Tests nur 60% Trefferquote bei guter Sicht erreichen, bei Schnee nur 30%. Trotzdem stehen Analysten unter immensem Druck, KI-generierte Zielvorschläge schnell freizugeben. Genau das zeigte WarGames: Das System sagt „Angriff“, und alle folgen dem System.

KI in Militärsystemen ist Realität. Das US-Verteidigungsministerium hat für 2026 insgesamt 13,4 Milliarden Dollar für autonome Systeme und KI beantragt. Der größte Einzelposten: 9,4 Milliarden für unbemannte Flugsysteme. Der Rolling Stone berichtet, dass Verteidigungsminister Hegseth den KI-Einsatz auf dem Schlachtfeld beschleunigt, während er gleichzeitig Aufsichtsbehörden für zivile Schäden schließt. Im März 2026 erhielt Anduril Industries einen 20-Milliarden-Dollar-Rahmenvertrag für KI-gestützte Kampfsysteme. WOPRs Szenario ist nicht mehr hypothetisch. Es ist budgetiert.

Reinforcement Learning ist der Standard. WOPRs Methode, Tausende Simulationen durchzuspielen und daraus zu lernen, heißt heute Reinforcement Learning. Es ist die Grundlage von AlphaGo, von OpenAIs Reasoning-Modellen, von autonomen Fahrzeugen. Genau wie WOPR lernen diese Systeme nicht durch Anweisungen, sondern durch wiederholtes Ausprobieren. Der Unterschied: WOPR kam am Ende zum richtigen Schluss. Ob das für alle heutigen WarGames KI Szenarien gilt, ist die offene Frage.

Was noch Fiktion bleibt

Die optimistischste Vorhersage von WarGames KI bleibt Fiktion: eine KI, die von selbst erkennt, dass Krieg sinnlos ist, und den Konflikt beendet.

Kein KI-System der Welt kann 2026 moralische Schlüsse ziehen. Kein Modell kommt eigenständig zu dem Ergebnis, dass „der einzige gewinnende Zug ist, nicht zu spielen“. KI optimiert, was man ihr vorgibt. Wenn das Ziel „Sieg“ heißt, sucht sie nach Wegen zum Sieg. Nicht nach Wegen zum Frieden.

Und genau hier liegt das Problem, das WarGames 1983 so klar formuliert hat: Nicht die KI ist die Gefahr. Die Gefahr ist die Frage, die man ihr stellt.

Wie genau hat WarGames KI die Zukunft vorhergesagt?

| Vorhersage | Status 2026 | Realitäts-Beispiel |

|---|---|---|

| Hacking durch Einzelpersonen als Bedrohung | Real | 289 Mrd. € Cyberschaden in Deutschland 2025 (Bitkom-Studie) |

| Automation Bias: Menschen vertrauen Maschinen blind | Real | Maven-Zielsystem: 60% Trefferquote, trotzdem eingesetzt (Brennan Center 2026) |

| KI in Nuklear- und Militärsystemen | Real | Pentagon: 13,4 Mrd. $ für autonome Systeme 2026, Anduril 20-Mrd.-Vertrag |

| Reinforcement Learning durch Simulation | Real | AlphaGo, OpenAI, autonome Fahrzeuge: trainiert durch wiederholtes Spielen |

| KI erkennt eigenständig, dass Krieg sinnlos ist | Fiktion | Kein KI-System kann 2026 moralische Schlüsse ziehen |