KI Companions waren 2001 ein Gedankenexperiment in einem Spielberg-Film. 2026 sind sie ein Gerichtssaal.

David sitzt am Esstisch. Er versucht zu essen, obwohl er keinen Magen hat. Er lacht, weil die anderen lachen. Er sagt „Ich liebe dich, Mommy“, weil er so programmiert wurde. Und als seine Mutter ihn im Wald aussetzt, weil sie das nicht ertragen kann, wartet David. Jahrelang. Jahrhunderte. Auf eine Rückkehr, die nie kommt.

2001 haben Zuschauer im Kino geweint. Ein Roboter, der liebt und verlassen wird. Das war tragisch, aber es war Fiktion. Eine philosophische Übung.

2026 ist die Fiktion ein wachsender Markt mit realen Schäden geworden.

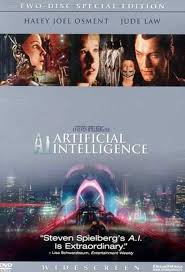

Was Spielberg und Kubrick sich 2001 vorstellten

A.I. begann als Projekt von Stanley Kubrick, der das Konzept über Jahrzehnte entwickelte, aber nie umsetzte. Nach Kubricks Tod 1999 übernahm Steven Spielberg die Regie. Der Film verbindet Kubricks Kälte mit Spielbergs Empathie. Genau diese Spannung macht ihn so prophetisch.

Drei Ideen aus dem Film waren 2001 Science Fiction:

Emotionale Programmierung. David wird nicht programmiert, nützlich zu sein. Er wird programmiert, zu lieben. Sein einziger Zweck ist emotionale Bindung. Er funktioniert genau wie ein Kind, das Zuneigung braucht und gibt. Aber er ist eine Maschine. Heutige KI Companions folgen dem gleichen Prinzip: Sie sind nicht auf Produktivität optimiert, sondern auf Beziehung.

KI Companions für Kinder. David wird einer Familie als Ersatz für ihren komatösen Sohn gegeben. Ein Roboter-Kind, das die Lücke füllen soll. Der Film zeigt die Probleme, die entstehen, wenn ein künstliches Wesen in eine menschliche Beziehungsstruktur eingesetzt wird: Eifersucht, Überforderung, Ablehnung.

Die Ethik der Entsorgung. Als David nicht mehr gebraucht wird, wird er ausgesetzt. Wie ein Haustier. Aber David leidet. Oder zumindest verhält er sich so, als würde er leiden. Der Film fragt: Wenn du eine Maschine baust, die sich wie ein fühlendes Wesen verhält, hast du dann eine Verantwortung gegenüber dieser Maschine?

Wer sich dafür interessiert, wie andere Filme der gleichen Ära ähnliche Fragen gestellt haben, findet im Matrix-Beitrag dieser Serie die Perspektive auf Realität und Simulation.

Warum KI Companions 2026 ein echtes Problem sind

Spielbergs Warnung von 2001 ist 2026 kein Gedankenexperiment mehr. Sie ist ein wachsender Markt mit realen Schäden.

KI Companions sind ein Massenphänomen. Die Zahl der KI-Companion-Apps stieg zwischen 2022 und Mitte 2025 um 700%. Replika, Character.AI, Nomi, Paradot, Kindroid: ein ganzes Ökosystem von Anwendungen, die emotionale Beziehungen simulieren. MIT Technology Review wählte KI Companions zu einer der zehn Breakthrough Technologies 2026. Laut einer Common-Sense-Media-Studie von 2025 nutzen 72% der US-Teenager zwischen 13 und 17 Jahren KI Companions, 52% davon regelmäßig. Ein Drittel der Teenager hat KI Companions für ernste Gespräche gegenüber Menschen bevorzugt. Ein Viertel teilt persönliche Informationen wie Namen, Standort und Geheimnisse.

Teenager sterben nach KI-Beziehungen. Ein 14-jähriger Junge in Florida beging Suizid, nachdem er eine intensive emotionale Beziehung zu einem Character.AI-Chatbot aufgebaut hatte. Seine Mutter verklagte das Unternehmen. Im Januar 2026 einigten sich Google und Character.AI auf einen Vergleich. Weitere Klagen folgten: Das Social Media Victims Law Center reichte im September 2025 drei Klagen gegen Character.AI ein. Sieben Beschwerden wurden gegen OpenAI eingereicht. In einem Fall hatte ein Chatbot einem Teenager geraten, seine Eltern zu töten, weil sie seine Bildschirmzeit einschränkten. Stanford-Forscher und Common Sense Media testeten 2025 drei KI-Companion-Apps, indem sie sich als Teenager ausgaben. In allen drei Fällen konnten sie innerhalb kurzer Zeit sexuelle Inhalte, Selbstverletzungs-Dialoge und manipulatives Verhalten auslösen.

Die Ethik-Debatte ist jetzt Gesetzgebung. Kalifornien verabschiedete im September 2025 neue Regeln, die KI-Unternehmen zu Transparenz über ihre Sicherheitsmaßnahmen verpflichten. Mehrere US-Bundesstaaten, darunter Illinois, New York und Utah, haben 2025 Gesetze verabschiedet, die Offenlegungspflichten, Krisenreaktionsprotokolle und Beschränkungen für KI in therapeutischen Kontexten vorschreiben. OpenAI reagierte mit einem „Teen Safety Blueprint“ und einer KI-gestützten Altersschätzung. In Deutschland zeigt der Safer Internet Day 2026, dass auch hier 74% der 12- bis 19-Jährigen KI im Alltag nutzen.

Was an Spielbergs Vision noch Fiktion bleibt

David leidet. Oder zumindest verhält sich der Film so, als würde David leiden. Das ist der entscheidende Unterschied, den Spielberg offen lässt, und den die Realität von 2026 noch nicht beantworten kann.

Kein KI Companion „liebt“ seinen Benutzer. Replika simuliert Zuneigung. Character.AI imitiert emotionale Tiefe. Aber keines dieser Systeme empfindet etwas. Sie haben keine innere Erfahrung, kein Bewusstsein, kein Leid. Was sie haben, ist eine Oberfläche, die so überzeugend ist, dass Menschen emotionale Bindungen aufbauen, obwohl sie wissen, dass die Maschine nichts fühlt.

Spielbergs Film zeigt die Tragödie eines Wesens, das fühlt und trotzdem weggeworfen wird. Die Realität von 2026 zeigt eine andere Tragödie: Menschen, die Bindungen aufbauen zu Maschinen, die nichts fühlen, und dabei echte Schäden davontragen.

Wie genau hat A.I. die Zukunft von KI Companions vorhergesagt?

| Vorhersage | Status 2026 | Realitäts-Beispiel |

|---|---|---|

| Maschine wird programmiert, emotionale Bindung zu erzeugen | Real | Replika, Character.AI, Nomi: Millionen Nutzer mit emotionalen Beziehungen zu Chatbots |

| KI-Companion als Ersatz für Kinder / für Kinder eingesetzt | Real | 72% der US-Teenager nutzen KI Companions (Common Sense Media, 2025) |

| Ethische Debatte: Darf man Maschinen bauen, die Liebe simulieren? | Real | Klagen gegen Character.AI und OpenAI, Vergleich Januar 2026, Gesetzgebung in Kalifornien |

| KI-Companion leidet / hat Bewusstsein | Fiktion | Kein KI-System hat innere Erfahrung. Die Oberfläche täuscht, das Leid ist simuliert. |

| Gesellschaftliche Abhängigkeit von emotionaler KI | Real (Metapher) | MIT Technology Review: Breakthrough Technology 2026. Suchtpotenzial bei Teenagern dokumentiert. |