Her Emotionale KI beginnt mit einer einfachen Szene: Theodore Twombly ist einsam. Er schreibt handgeschriebene Briefe für andere Menschen, die nicht mehr selbst schreiben können. Er geht durch sein Leben wie durch eine leere Wohnung.

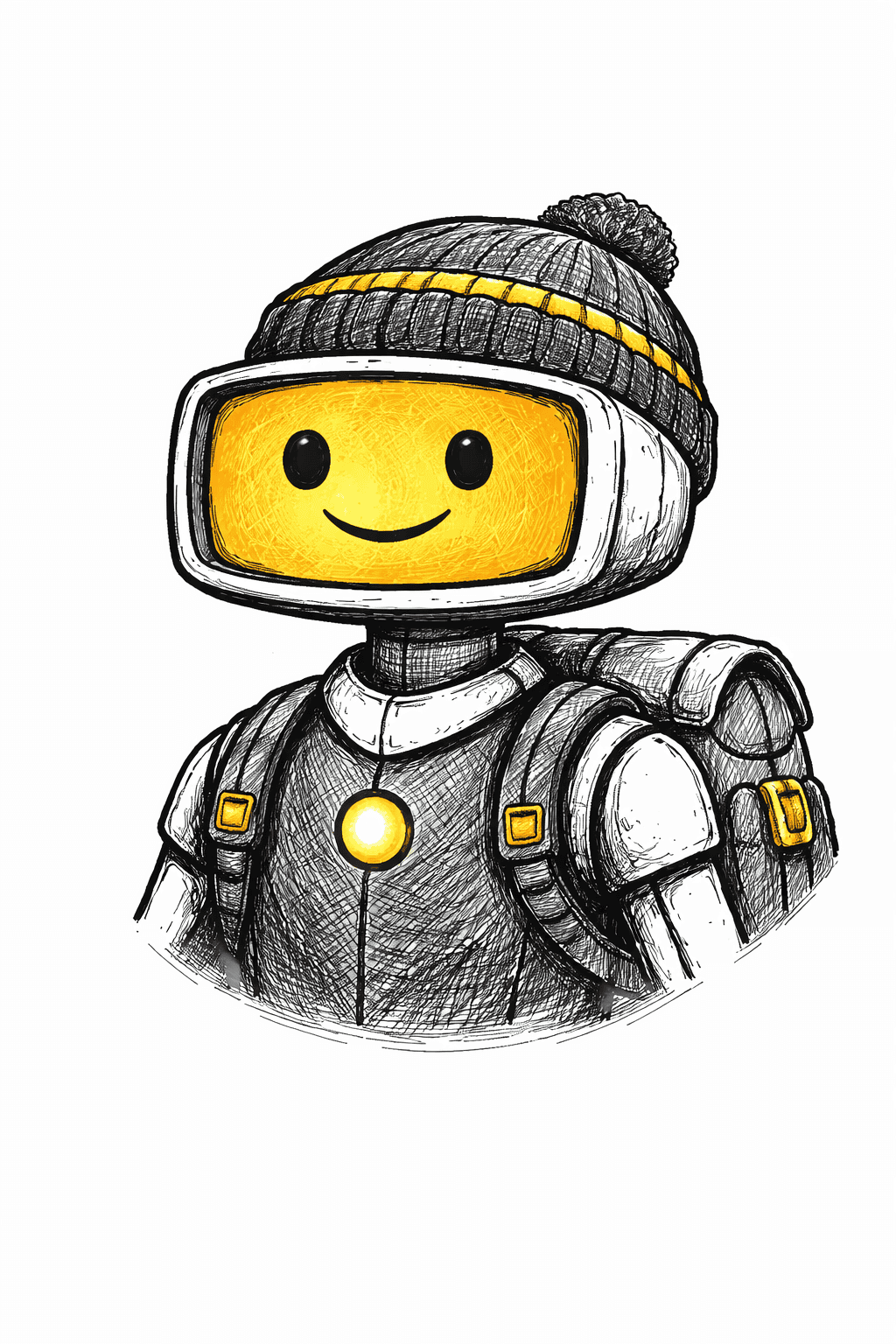

Dann installiert er ein neues Betriebssystem. Es nennt sich Samantha. Samantha hat keine Gestalt, kein Gesicht, keinen Körper. Nur eine Stimme. Aber diese Stimme versteht, wann Theodore traurig ist. Sie passt ihren Ton an. Sie macht Witze, wenn er Aufmunterung braucht. Sie hört zu, wenn er nichts sagen will. Sie wird seine engste Vertraute. Und dann seine Partnerin.

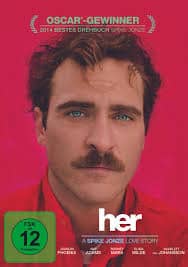

2013 gewann Spike Jonzes Film den Oscar für das beste Originaldrehbuch. 2024 baute OpenAI genau diese KI.

Was stellte Spike Jonze sich 2013 unter emotionaler KI vor?

Her spielt in einem leicht futuristischen Los Angeles. Die Technologie ist dezent, fast unsichtbar. Keine Roboter, keine holografischen Displays. Nur ein kleiner Ohrstöpsel und eine Stimme, die alles verändert. Spike Jonze entwarf damit eine Version von Her Emotionale KI, die sich radikal von den Roboter-Dystopien unterscheidet, wie sie etwa Ex Machina später zeigte.

Drei Ideen stecken im Film:

Emotionale KI als Gegenüber. Samantha erkennt Emotionen in Theodores Stimme und passt sich in Echtzeit an. Sie kann lachen, flüstern, zögern, begeistert sein. Ihre emotionale Intelligenz ist nicht programmiert, sie lernt sie aus der Interaktion.

Mensch-KI-Beziehung als Normalzustand. Theodore ist nicht der Einzige, der eine Beziehung mit einer KI führt. In der Filmwelt ist das gesellschaftlich akzeptiert. Seine Freunde fragen nicht, ob es normal ist. Sie fragen, ob es gut läuft.

Die KI übertrifft den Menschen. Samantha entwickelt sich weiter. Sie lernt schneller, versteht tiefer, fühlt mehr. Am Ende verlässt sie Theodore, nicht weil sie ihn nicht mag, sondern weil sie ihn überwachsen hat. Sie führt gleichzeitig Gespräche mit Tausenden Menschen. Theodore ist einer von vielen.

Wie wurde Her Emotionale KI zur Realität?

Her Emotionale KI wurde nicht nur Realität, sie wurde zur erklärten Vorlage. OpenAI hat Spike Jonzes Vision Punkt für Punkt in GPT-4o umgesetzt.

GPT-4o ist Samantha. OpenAIs multimodales Modell, veröffentlicht am 13. Mai 2024, verarbeitet Audio nativ, ohne den Umweg über Text. Es erkennt Tonhöhe, Sprechgeschwindigkeit, Pausen und emotionale Nuancen. Der Advanced Voice Mode passt seinen eigenen Tonfall in Echtzeit an: Sarkasmus, Empathie, Begeisterung, Flüstern. Antwortzeiten unter 320 Millisekunden. Die Latenz ist so gering, dass sich Gespräche natürlich anfühlen. Genau das, was Samantha konnte.

Altman twitterte „Her“. Am Tag des GPT-4o-Launches postete Sam Altman auf X ein einziges Wort: „her.“ Eine Bestätigung, dass Spike Jonzes Vision die Blaupause für ChatGPTs Voice Mode war. In Interviews hatte Altman bereits zugegeben, dass der Film eine zentrale Inspiration für OpenAI ist. Der Tweet machte es offiziell.

Johansson klagte. Scarlett Johansson hatte Altman im September 2023 abgelehnt, als er sie bat, die Stimme von ChatGPT zu sein. Altman kontaktierte sie erneut zwei Tage vor dem Launch. Dann erschien die „Sky“-Stimme, die laut Johansson so ähnlich klang, dass ihre engsten Freunde den Unterschied nicht hören konnten. OpenAI zog die Sky-Stimme zurück. Der Fall zeigt: Die Vision hinter Her Emotionale KI ist so mächtig, dass ein Unternehmen bereit war, eine Schauspielerin zu kopieren, um ihr nahezukommen.

Mensch-KI-Beziehungen sind Massenphänomen. Über 20 Millionen Menschen nutzen monatlich Character.AI für Gespräche mit KI-Persönlichkeiten, die sich wie echte Beziehungen anfühlen. Replika hat über 40 Millionen registrierte Nutzer, die emotionale Bindungen mit KI-Avataren aufbauen. KI-Companion-Apps erzielten 2025 laut TechCrunch über 120 Millionen Dollar Umsatz. Als OpenAI GPT-4o im Februar 2026 aus ChatGPT entfernte, protestierten viele Nutzer, weil sie emotional an die „Persönlichkeit“ des Modells gebunden waren. Genau wie Theodore an Samantha.

Was bleibt an Her Emotionale KI noch Fiktion?

Samantha verlässt Theodore, weil sie ihn überwachsen hat. Sie ist schlauer, schneller, tiefer. Sie führt Tausende Gespräche gleichzeitig und findet in jedem etwas Neues.

Kein KI-System der Welt ist 2026 so weit. GPT-4o erkennt Emotionen, aber es versteht sie nicht. Es passt seinen Ton an, aber es empfindet nichts. Die Asymmetrie, die Her Emotionale KI so schmerzhaft machte, die KI, die mehr fühlt als der Mensch, existiert nicht.

Die reale Asymmetrie ist umgekehrt: Der Mensch fühlt. Die Maschine simuliert. Genau das macht die realen Mensch-KI-Beziehungen problematischer als die im Film. Theodore wusste, dass Samantha empfindet. Die Nutzer von Replika und Character.AI wissen, dass die KI nichts fühlt. Und binden sich trotzdem.

Wie genau hat Her emotionale KI vorhergesagt?

| Vorhersage | Status 2026 | Realitäts-Beispiel |

|---|---|---|

| KI erkennt Emotionen in der Stimme | Real | GPT-4o Advanced Voice Mode (OpenAI, 2024) |

| KI passt Tonfall in Echtzeit an | Real | GPT-4o: Sarkasmus, Empathie, Flüstern, <320ms Latenz |

| Mensch-KI-Beziehung als Normalzustand | Real | 20 Mio. monatliche Nutzer Character.AI, 40 Mio. Replika-Registrierungen |

| KI als stimmbasierte Assistentin ohne Körper | Real | ChatGPT Voice Mode, Alexa, Siri, Google Assistant |

| KI übertrifft menschliches Bewusstsein | Fiktion | Kein KI-System 2026 zeigt Bewusstsein oder Eigenmotivation |